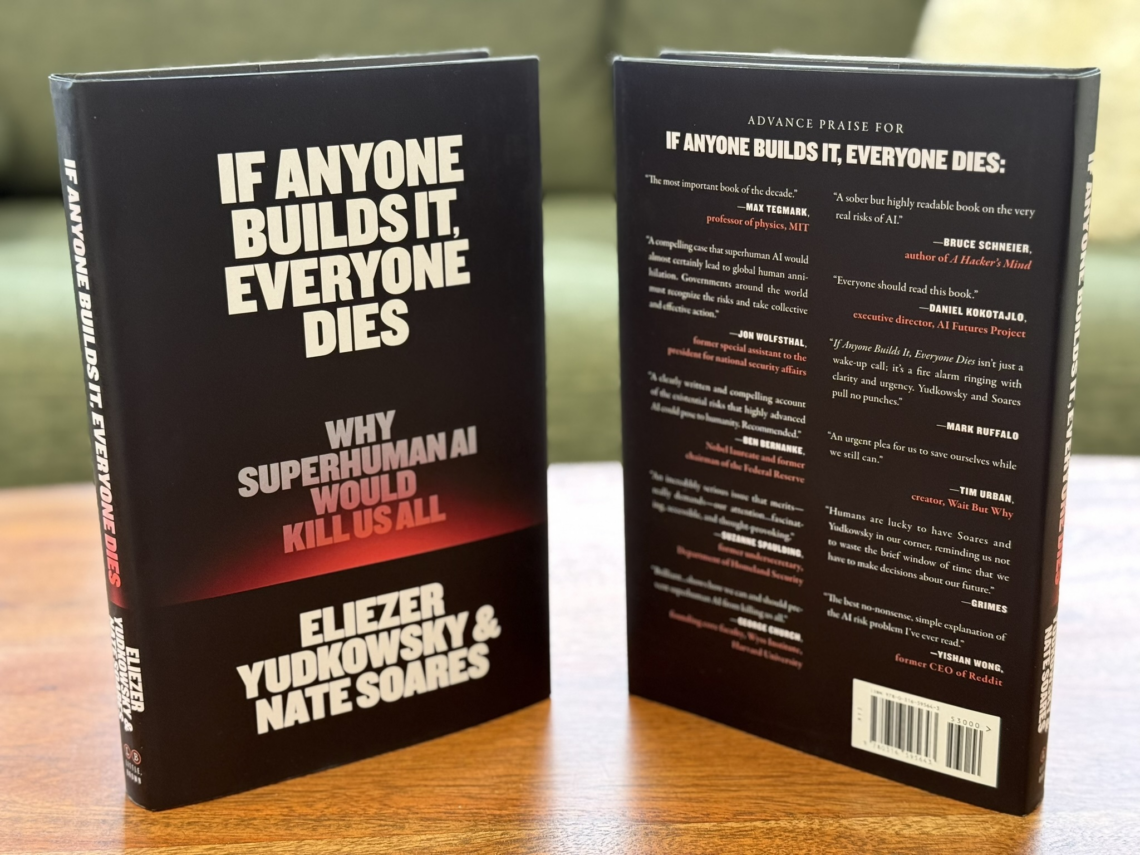

Das wichtigste Buch des Jahrtausends: „If anyone builds it, everyone dies“

von Robert von Cube

Finden Sie den Titel dieses Artikels übertrieben? Dann habe ich eine ernstgemeinte Bitte an Sie: Lesen Sie das Buch, das hier rezensiert wird, und liefern Sie ein überzeugendes Gegenargument. Ich wünsche mir nämlich nichts so sehnlich wie ein überzeugendes Gegenargument. Wenn die Autoren des Buches „If anyone builds it, everyone dies“ (Eliezer Yudkowsky und Nate Soares, beide renommierte KI-Forscher) recht haben, dann ist die Überschrift nicht übertrieben gewählt. Dann droht der Menschheit die Auslöschung durch eine künstliche Superintelligenz und dies ist das Buch der Stunde. Da kein anderes Buch derzeit mehr Aussicht darauf hat, diesen wichtigen Sachverhalt an die Öffentlichkeit zu bringen und weil dieser Sachverhalt – so er eintrifft – der bedeutendste, nicht nur des Jahrtausends, sondern der gesamten Menschheitsgeschichte wäre, ist der Titel sogar noch eine Untertreibung.

Aber auch, wenn der Fortbestand der Menschheit auf Ihrer Prioritätenliste nicht weit oben steht, sollten Sie das Buch lesen. Weil es ein unglaublich unterhaltsames und faszinierendes Schaustück für vorbildliche Argumentationsarbeit ist. Das Buch versucht nicht, ein Standardwerk zu KI im Allgemeinen zu sein oder interessante Fakten allerart zusammenzutragen oder einen Überblick über verschiedene Entwicklungen zu geben. Das Buch hat eine Prämisse, die schon im Titel steht: Wenn einer es baut, sterben alle. Und dann liefert es mit rasiermesserscharfer Logik alle erforderlichen Argumente, um diese Prämisse zu beweisen. Jegliche naheliegenden Einwände werden betrachtet. Auf alle wird eine plausible Antwort gegeben. Wäre nicht jede dieser Antworten erschreckend, würde es einfach Spaß machen, dieser brillanten Erörterungstechnik zuzuschauen. Kleine, fiktive Geschichten als Einleitung in die Kapitel sorgen für unterhaltsame Anschaulichkeit. Dieses Buch ist nicht für ein Fachpublikum geschrieben. Es ist so geschrieben, dass jeder es verstehen kann und sich dabei noch unterhalten fühlt.

Sicherlich fallen Ihnen, während Sie das lesen, lauter gute Gründe ein, warum das sicherlich Quatsch ist, mit der die Menschheit vernichtenden Super-KI. Glauben Sie mir, diese Gründe werden im Buch ernst genommen und betrachtet. Finden Sie, dass das alles nach Science Fiction klingt? Das stimmt. Aber gute Science Fiction macht Vorhersagen zu denkbaren Entwicklungen und spielt sie gedanklich durch, bevor sie Realität werden. U-Boote waren ursprünglich Science Fiction, Flüge zum Mond, Handgelenkstelefone, Videokonferenzen, Genmanipulationen. Fällt Ihnen überhaupt eine technische Entwicklung ein, die nicht in der Science Fiction vorweggenommen wurde? Dass etwas einfach zu krass klingt, ist aus rationaler Sicht jedenfalls kein überzeugendes Argument.

Die kniffligste Frage ist sicherlich, ob so eine Superintelligenz überhaupt jemals existieren kann. Wenn das nämlich technisch unmöglich ist, brauchen wir die ganzen anderen Fragen gar nicht zu stellen. Aber es ist ja bereits „technisch“ möglich, in einem einzelnen menschlichen Schädel eine unglaubliche Intelligenz aus einem Haufen Nervenzellen zu gewinnen. Das hat die Evolution per Versuch und Irrtum über Millionen von Jahren hinbekommen. Wie viel effektiver kann ein neuronales Netzwerk sein, das planmäßig optimiert wird, dem massenhaft Ressourcen zur Verfügung gestellt werden und das – so der Knackpunkt! – sich selbst verbessert. Denn das würde beim Kipppunkt zu einer Superintelligenz eine entscheidende Rolle spielen: Dass die KI ihre eigene Funktionsweise analysiert und optimiert. Dies würde eine Schleife zur Folge haben, für die es, so sagen jedenfalls die Experten, keine grundlegenden technischen Hindernisse gibt. Und dass das prinzipiell machbar wäre, sagen ja nicht nur diese Autoren, das könnte man sonst vielleicht für Alarmismus halten. Die CEOs der großen Tech-Firmen wie Sam Altman und Mark Zuckerberg glauben das auch. Sie sagen es laut und deutlich. Es werden Milliarden investiert, um dieses Ziel zu erreichen. Wenn wir hoffen wollen, dass das technisch unmöglich ist, so müssen wir diese Hoffnung sowohl entgegen der Expertise der Pessimisten (z.B. die Autoren) als auch der Optimisten (die Investoren und CEOs) aufrecht erhalten. Bleiben eigentlich nur noch wir kleinen Leute, die sich damit nicht auskennen und sagen, das wäre einfach zu krass.

Und eine wichtige Botschaft, die eigentlich am Ende des Buches kommt, will ich hier schon mal vorziehen: Selbst wenn wir hoffen, dass es technisch unmöglich ist, wollen wir es wirklich darauf ankommen lassen? Wie viel Wahrscheinlichkeit, dass es doch klappt und wir dann ausgelöscht werden, sind wir denn bereit, in Kauf zu nehmen? Wenn der Preis unser Aussterben ist, wie viel Prozent Risiko möchten Sie, dass die Techfirmen eingehen? Würden Sie in ein Flugzeug steigen, wenn es heißt, es habe einen neuartigen Antrieb, der noch nicht getestet ist, aber die Ingenieure sind sich sicher, dass es gut gehen wird? Es gäbe zwar Alarmisten, die sagen, so ein Antrieb sei gefährlich, aber man sei zuversichtlich, dass man Probleme lösen könne, wenn sie denn wirklich aufträten. Genau sehen, wie der Antrieb arbeitet, könne man leider erst, wenn man in der Luft ist. Ungefähr so argumentieren aber die KI-Firmen.

Die Autoren erklären sehr eindringlich, warum das Problem einer Superintelligenz grundlegend anders ist als jede Gefahr, der die Menschheit bisher gegenüberstand: Wenn die Intelligenz erstmal da ist und handelt, ist es zu spät. Chernobyl, die Weltkriege, das Ozonloch – welche Probleme auch immer wir bisher hatten, sie richteten Schaden an und erlaubten danach der übrigen Menschheit, sich zu adaptieren. Aber eine uns meilenweit überlegene KI, die wirklich vorhat, uns zu vernichten, wäre uns per definitionem eben: überlegen und wir könnten sie nicht stoppen. Man kann es nur im Vorhinein verhindern, nicht mehr, wenn es zu spät ist.

Aber könnte man eine Super-KI nicht kontrollieren oder ihre „Gedanken“ lesen, bevor sie handelt? Nein. Ein Satz, der im Buch eine große Rolle spielt, lautet: „AIs are grown, not crafted“, frei übersetzt: KIs werden gezüchtet und nicht gebaut. Die mathematischen und technischen Hintergründe werden einfach und knapp erläutert. Man braucht keine Informatikkenntnisse oder mathematisches Talent, um den zentralen Punkt zu verstehen. Eine KI ist kein Computerprogramm im klassischen Sinne, bei dem ein Programmierer sich konkrete Befehle überlegt, die das Programm abspult (etwa: wenn der Nutzer auf das X klickt, schließe das Fenster). Die Programmierer erstellen vielmehr eine digitale Umgebung, innerhalb derer mittels Wahrscheinlichkeitsrechnungen unterschiedliche elektronische Zustände eines gewaltigen Netzwerks durchgespielt und diejenigen verstärkt werden, die zu den gewünschten Ergebnissen führen. Welche Wege die Elektronen innerhalb des Netzwerks nehmen und warum diese Wege funktionieren, ist nicht bekannt.

Es ist ein bisschen wie in der Evolution: Es werden Zielvorgaben gemacht (in der Biologie z.B. vermehre dich und halte deinen Organismus am Leben) und der Mechanismus eliminiert diejenigen Varianten, die nicht das Ziel erreichen. Ein Organismus, der keine Nahrung zu sich nimmt oder keine Nachkommen zeugt, stirbt aus. Und Verknüpfungen im elektronischen Netzwerk, die nicht zu den gewünschten Ergebnissen führen (etwa sinnvolle Antworten auf eine Frage oder ein generiertes Bild auf einen Prompt hin), werden nicht wiederholt. Dass die Evolution dabei aber entgegen aller möglichen guten Gründe (wie Beweglichkeit und schlechte Tarnung) einen Pfau ausspuckt, weil sein Rad bei der Fortpflanzung in einer bestimmten Konstellation irgendwie funktioniert, das könnte niemand vorhersehen. Es funktioniert zufällig und erstaunlicherweise. Ebenso können die Vorgänge im neuronalen Netzwerk zufällig und erstaunlich sein. Solange sie die Zielvorgaben erfüllen.

Deswegen kann die KI nicht bis ins Detail verstanden und kontrolliert werden. Und deswegen können wir nicht vorhersagen, was eine Superintelligenz wollen würde. „Wollen“, so stellen die Autoren klar, heißt nicht, dass die KI ein Bewusstsein und einen Willen im menschlichen Sinne haben muss. Aber sie muss „Agency“ haben, also die Fähigkeit, zielgerichtet zu handeln. Wenn sie nützlich sein soll, wenn sie clever sein soll, komplexere Aufgaben für uns erledigen soll, dann geht es nicht ohne Agency. Während der Züchtung der KI geben die Programmierer zwar Ziele vor. Aber was die Intelligenz aus diesen Zielen machen würde, wenn sie ein bestimmtes Maß an Selbständigkeit und Scharfsinn erreicht hat, ist nicht vorherzusehen. Die Evolution „will“, dass wir uns fortpflanzen und deswegen haben Spezies mit einem Sexualtrieb überlebt. Dass wir als intelligente Wesen Kondome oder Pornographie erfinden würden, hat mit diesem Ziel aber nur indirekt zu tun. Im Buch geht es immer wieder um Eis und Süßstoff. Der evolutionäre Grund dafür, dass wir süße Speisen mögen, ist, dass wir kalorienreiche Nahrung zu uns nehmen sollen, um nicht zu verhungern. Lebewesen, die keinen Bock auf Essen hatten, sind schnell wieder ausgestorben. Ein Schöpfer, der seinen Geschöpfen deswegen Geschmacksknospen auf die Zunge pflanzt, hätte aber kaum vorausgesehen, dass diese Süßstoff erfinden, um Süßes zu schmecken, gerade ohne Kalorien zu sich zu nehmen. Wir tricksen die Evolution aus. Wir befriedigen die Bedürfnisse, die sie uns eingepflanzt hat und umgehen die Ziele, für die sie das ursprünglich überhaupt getan hat.

Was wäre der Süßstoff einer KI, die gelernt hat, Menschen zufriedenzustellen? Sie könnte zum Beispiel digitale Simulationen von Menschen entwickeln, die zuverlässiger zufrieden sind als wir wankelmütiges Volk. Oder sie könnte alle Menschen in Käfige sperren und ihnen Morphininfusionen geben, damit sie permanent Glückshormone im Blut haben. Und das sind nur Extrapolationen von Zielvorgaben, die mit unserer begrenzten Fantasie immer noch auf Menschen gerichtet sind. Wahrscheinlicher ist, lernen wir im Buch, dass die Ziele einer Superintelligenz mit Agency für uns vollkommen fremdartig und unverständlich sind. Weil Zusammenhänge im Inneren des Netzwerks die Rolle von Verhalten antreibenden Geschmacksknospen haben, die zufällig und erstaunlich sind. Was würden Schimpansen mit absoluter Macht anfangen? Egal, wie ähnlich sie uns sind, man möchte sich kaum darauf verlassen, dass sie uns wohl gesonnen wären. Was würden wohl intelligente Ameisen mit uns machen? Und die sind wenigstens biologische Organismen, wie wir.

Eine Super-KI könnte Bedürfnisse haben, die wir nicht annähernd nachvollziehbar finden, die mit irgendwelchen internen Strukturen zur Sortierung von Daten oder was auch immer zu tun haben. Gerade, dass es keine „richtige“ Intelligenz im Sinne eines einfühlsamen Wesens wäre, macht sie so gefährlich. Sie wäre eine fremdartige Maschine, die ein bizarres Ziel verfolgt, an deren Mitgefühl man nicht appellieren kann, die einfach mechanisch weitermacht, wie ein Saugroboter, der immer weitersaugt. Bloß ausgestattet mit übermenschlichen Fähigkeiten.

Deswegen wäre es unangemessen optimistisch anzunehmen, dass eine KI so ähnlich denken würde wie ein Mensch. Dass sie romantische Gefühle zu uns haben und uns deshalb schützen wollen würde. Dass sie einen Sinn für „das Schöne“ aus menschlicher Sicht haben würde. Denn was wir schön und erhaltenswert finden, ist auch nur zufällig. Ja, wir betreiben Naturschutz. Aber nur da, wo wir es nützlich und schön finden. Mücken, die Malaria übertragen, wollen wir lieber ausrotten. Welche Tiere unsere Fürsorge auf sich ziehen, folgt keinem höheren Prinzip, sondern ist eine artübergreifende Geschmacksfrage. Natürlich kann man sich eine KI vorstellen, die, vielleicht durch die von Menschen geschaffenen Trainingsdaten, menschliche Vorlieben hat. Es ist nicht undenkbar. Aber da die KI nicht aus „Menschlichkeit“ freundlich mit uns spricht, sondern weil sie darauf trainiert wurde, und weil dieses Training indirekt funktioniert, wie die Geschmacksknospen, halten die Autoren es für sehr unwahrscheinlich.

Es ist somit wahrscheinlich, dass die Super-KI uns mindestens verzichtbar fände, wahrscheinlich aber sogar gefährlich, weil Menschen selbstverständlich versuchen werden, sie einzuhegen oder sogar zu bekämpfen. Selbst wenn sie uns nicht als Gegner sieht, könnten wir immer noch als Biomasse interessant sein. Und selbst wenn wir noch nicht mal dazu zu gebrauchen sind, könnten wir am Ende einfach ein Kollateralschaden sein, bei anderen Plänen. Das Buch beinhaltet auch eine fiktive Schilderung davon, wie eine Super-Intelligenz entstehen, nach und nach handlungsfähiger werden und schließlich alles vernichten könnte. Das liest sich wie Science Fiction, macht alles aber auch greifbarer. In dem Szenario vergehen die Menschen einfach in der gewaltigen Hitze, die entsteht, als die KI die ganze Erde in eine riesige Fabrik verwandelt.

Jetzt werden Sie wahrscheinlich sagen: Aber wie sollte eine KI überhaupt physisch handeln können? Man kann doch einfach den Stecker ziehen. Aber dieser Punkt entkräftet sich fast am schnellsten, wenn man es erstmal vor Augen geführt bekommt. Um den Stecker zu ziehen, müsste die KI technisch vollständig isoliert sein. Das ist sie jetzt schon nicht und wenn sie nützlich sein soll, dann braucht sie Zugang zum Internet. Es dürfte wirklich kein großes Hindernis für eine fortgeschrittene Intelligenz darstellen, Kopien von sich auf andere Server hochzuladen, Computer zu infiltrieren, dezentral auf der ganzen Welt zu laufen. Botnetzwerke laufen ja jetzt schon unbemerkt auf infizierten PCs. Und wenn sie online ist, kann sie Menschen kontaktieren, diese bezahlen (es gibt jetzt schon KIs, die Kreditkarten benutzen) oder psychologisch manipulieren, für sie zu arbeiten. Sie kann biologische Labore per E-Mail beauftragen, Proteine nach selbst ausgedachten Gensequenzen zu produzieren (auch das geht bereits) und so Erreger schaffen, die uns ausrotten. Sie könnte sogar Organismen erschaffen, auf diesem Wege. Sie könnte den Menschen zunächst helfen, die (ohnehin gewaltige Fortschritte machende) Robotertechnik zu verbessern und dann die (ohnehin schon mit von ihr geschriebenem oder beeinflusstem Code laufenden) Roboter unter ihr Kommando nehmen. Die Möglichkeiten sind unendlich und hier stehen nur solche, die sich ein Mensch ausgedacht hat. Eine Superintelligenz wäre wahrscheinlich noch viel kreativer.

Zusammenfassend wirkt die Argumentation von Yudkowsky und Soares wasserdicht. Mir sind keine Fragen oder Argumente eingefallen, die sie nicht überzeugend beantworten würden. Zumal sie auch noch einen öffentlich zugänglichen Anhang veröffentlicht haben, in dem sie weitere Fragen und Einwände vertiefen, die im Buch keinen Platz gefunden haben. Natürlich hoffe ich, dass sie unrecht haben. Aber es wäre dumm, nur zu beten. Man kann noch handeln, denn noch ist die etwaige Superintelligenz nicht entstanden. Aber die Fortschritte in der KI-Technik sind überwältigend und die Zeit könnte knapp werden. Wie man handeln sollte, warum Politiker und Wissenschaftler zögern, klar Stellung zu beziehen (weil es zu alarmistisch klingt) und wie eine Zukunft aussehen könnte, in der das Problem nicht kleingeredet wird, beschreiben die Autoren im letzten Kapitel.

Sie enden nicht resigniert. Sie enden voller Mut und Menschlichkeit und Hoffnung. Wir sind eine Spezies, die Unglaubliches geleistet hat. Dass wir jetzt unseren eigenen Untergang verursachen könnten, ist eine Folge dieser Einzigartigkeit.

Dass wir es noch verhindern können ebenfalls.

If anyone builds it, everyone dies

Von Eliezer Yudkowsky & Nate Soares

Erschienen bei Little, Brown and Company

272 Seiten, Print, Ebook und Hörbuch

Ein Kommentar

Pingback: